Därför kan vi inte längre lita på Pisa

Publicerad

17 Dec 2019 05:00

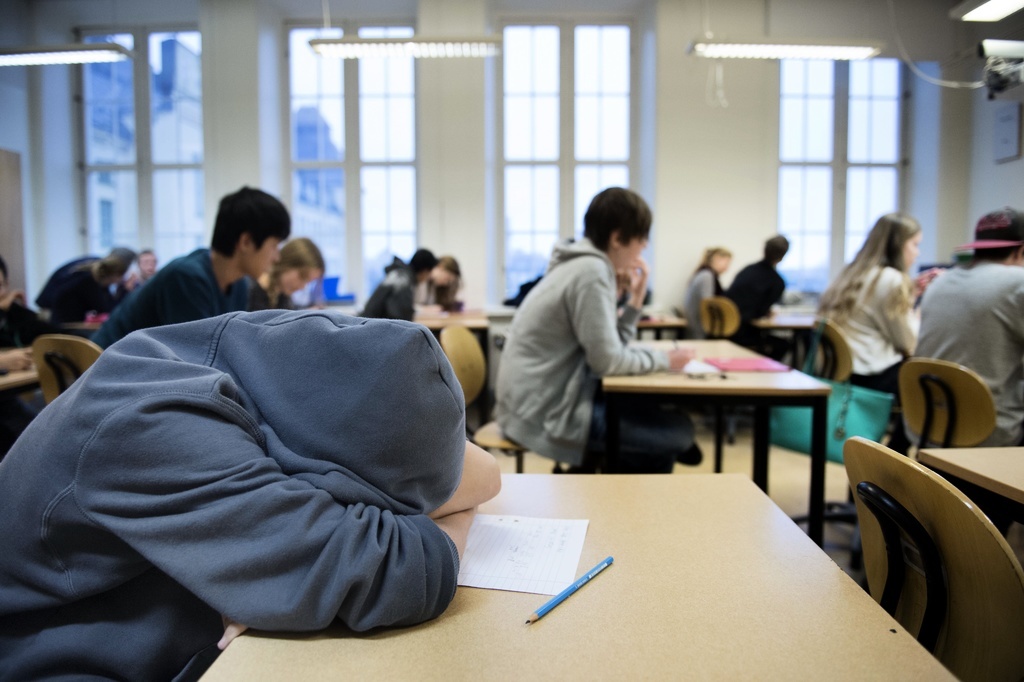

En trött högstadieelev sover med huvudet på bänken under en lektion. Foto: Jessica Gow / TT

Om vi tycker att skolan ska fungera väl för alla elever och inte bara för de etniskt svenska så är det dags att dämpa hurra-ropen för det senaste Pisa-testet. Sverige förbättrade resultaten på ett artificiellt sätt genom att en fjärdedel av eleverna antingen inte fick göra provet eller inte dök upp. En försiktig uppskattning tyder på att i verkligheten befinner sig en dryg tredjedel av 15-åringarna i Sverige på den lägsta nivån vad gäller läsfärdighet, skriver Magnus Henrekson och Johan Wennström i en analys för Kvartal.

Vad tycker du?

0

Skribenter

Presenteras av

Skribenter

Vad tycker du?

0